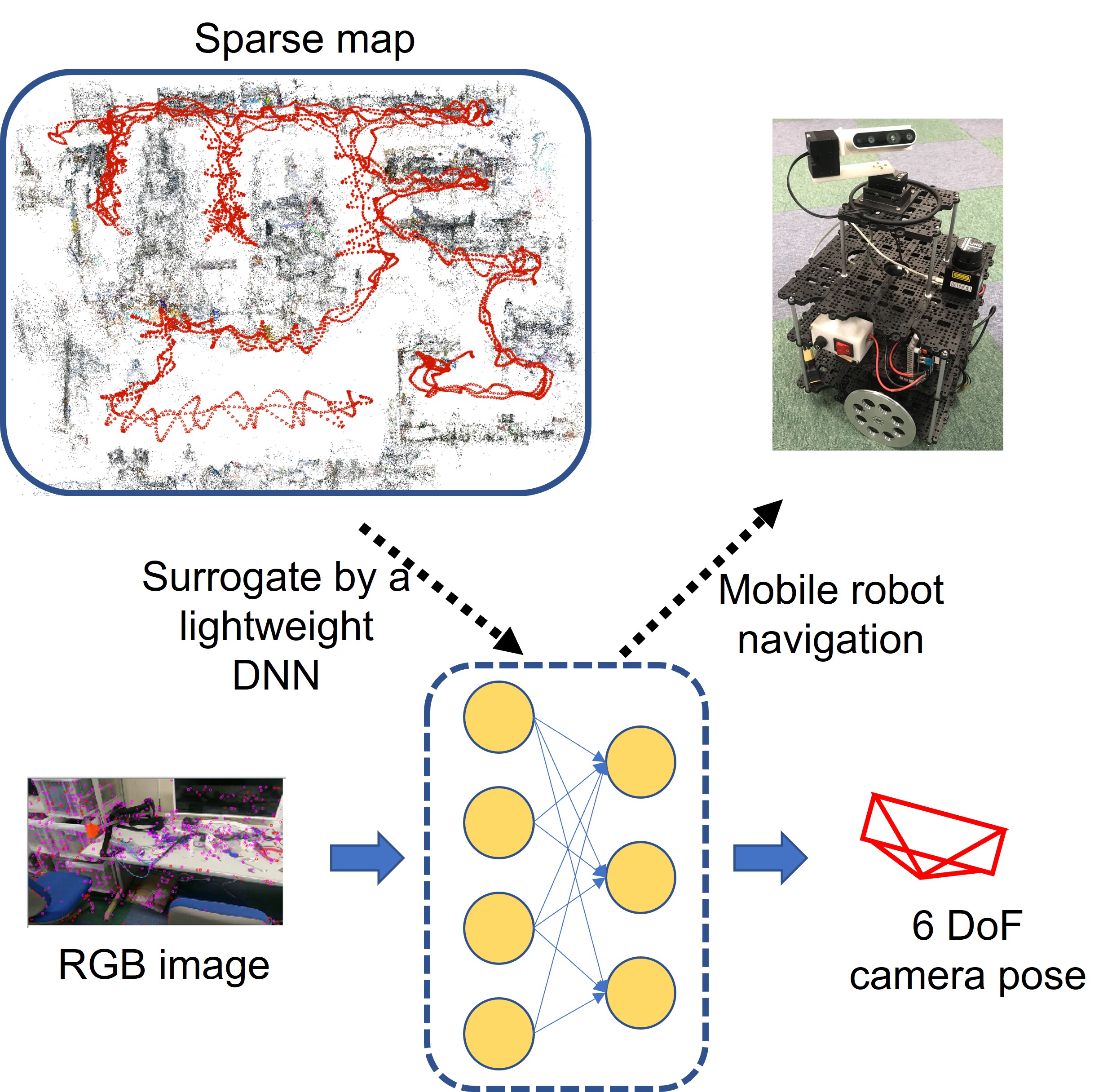

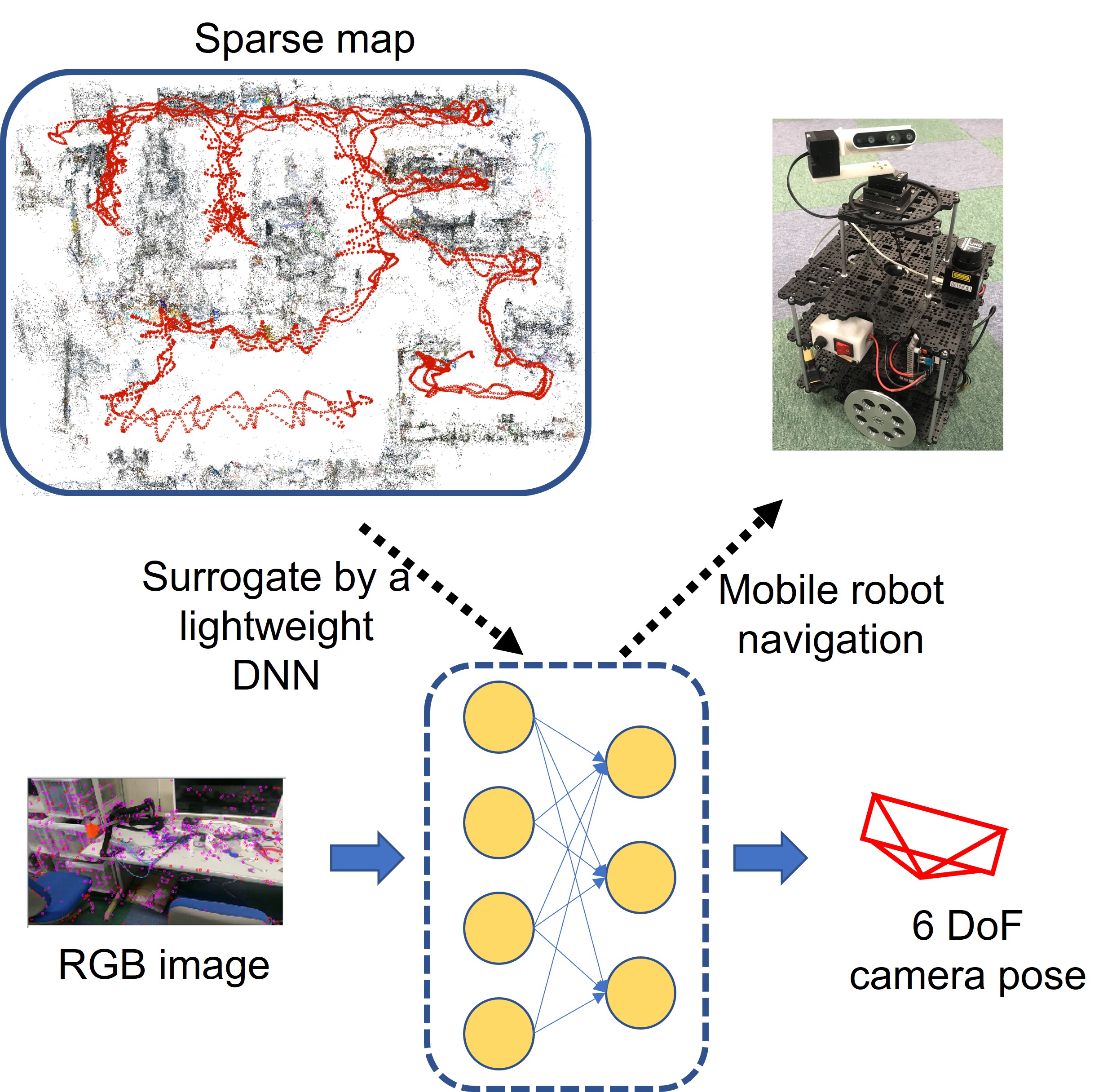

多くの複合現実やロボット工学を用いた応用シーンにおいて,3次元再構成のためにカメラ位置を推定する事は,重要な役割を担っている.事前に構築された3Dモデルを用いてカメラの姿勢推定は,ストレージや通信帯域幅が制限された環境では,膨大なコストが生じる.本研究では,シーン座標をマッピングするための多層パーセプトロンネットワークのみを用いたシンプルなシーン回帰法を提案し,正確なカメラ姿勢推定が可能となった.その結果,計算機資源の限られたモバイルロボットや家電製品等に搭載可能なシステムを実現した.

移動ロボットナビゲーションのための軽量化ソリューション

多くの複合現実やロボット工学を用いた応用シーンにおいて,3次元再構成のためにカメラ位置を推定する事は,重要な役割を担っている.事前に構築された3Dモデルを用いてカメラの姿勢推定は,ストレージや通信帯域幅が制限された環境では,膨大なコストが生じる.本研究では,シーン座標をマッピングするための多層パーセプトロンネットワークのみを用いたシンプルなシーン回帰法を提案し,正確なカメラ姿勢推定が可能となった.その結果,計算機資源の限られたモバイルロボットや家電製品等に搭載可能なシステムを実現した.